Paula Ramos Giraldo、Søren Skovsen、Mayuresh Sardesai、Dinesh Bhosale、Maria Laura Cangiano、Chengsong Hu、Aida Bagheri Hamaneh、Jeffrey Barahona、Sandy Ramsey、Kadeghe Fue、Manuel Camacho、Fernando Oreja、Helen Boniface、Ramon Leon Gonzalez、Edgar Lobaton、Chris Reberg-Horton、Steven Mirsky。

雜草是農業面臨的最大挑戰之一;它們與作物競爭可利用的養分、水和陽光。

許多方法,最著名的是RGB感測器,已被用於使用計算機視覺識別和繪製雜草圖。例如,一個簡單的線狀除草器(也稱為“割草機”)與攝像頭配對,可以控制生長點未受保護的非常小的雜草。隨著雜草變得更大且更具侵入性,可能需要更昂貴的方法,並且使用機器人安裝的雷射器已經取得了一些成功。

然而,迄今為止,還沒有人成功地將深度資訊與目標識別同時整合用於雜草管理。利用3D資訊,例如帶深度功能的OpenCV AI套件(OAK-D)提供的資訊,我們可以根據生長點的位置和植物的整體耐受性來改變控制方法。

監測和繪製雜草生長圖是精確可持續農業(PSA)團隊的主要目標之一。PSA團隊開發用於監測氣候、土壤和農業管理對田間作物生產影響的工具,目標是改善農民的決策。

我們使用新的OpenCV攝像頭OAK-D和英特爾OpenVINO工具套件發行版,開發了一種用於精確測量田間條件下雜草高度和覆蓋面積的半自動化非侵入性方法。專案在2020年OpenCV AI競賽中獲得好評,並榮獲榮譽獎。

以下是我們的操作方法。

硬體

首先,田間團隊前往田間,收集樣帶資訊,確定已出現的雜草型別,並測量雜草高度和地面覆蓋率。

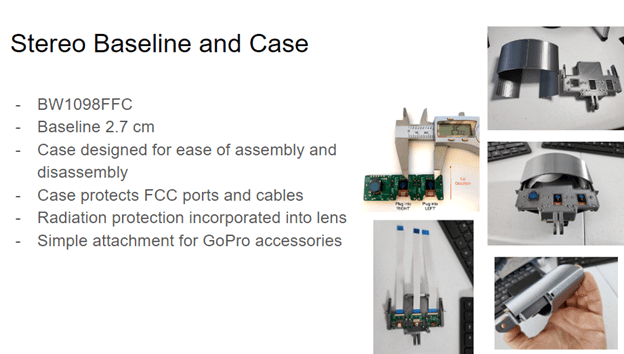

注意:在專案期間,我們不得不更換使用的攝像頭,因為OAK-D(BW1098OBC)缺貨。相反,我們使用了一種由相同軟體支援的類似攝像頭技術(圖1),其中元件未整合到單個板上。此版本的攝像頭(BW1098FFC)具有三個FFC埠和可調節的基線,這允許更短的最小深度距離。

設定

材料清單(圖2)

- 平板電腦(聯想P10或M10/或類似的Android裝置)

- 帶肩帶的伸縮單腳架

- OAK-D攝像頭(BW1098FFC)

- 樹莓派4帶32GB或更大容量的micro SD卡

- 攝像頭和樹莓派的移動電源(2個輸出10000mA)

- 線纜

- 腰包

- 平板電腦三腳架安裝介面卡

- 迷你球形雲臺(#2)

- 鏡頭布和刷子。

我們的目標是建立一個易於使用、低成本的工具,使我們國家田間科學家團隊能夠量化農場和研究站的雜草效能。

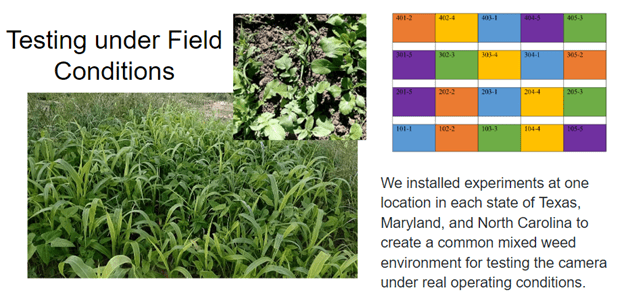

我們建立了五個配備上述所有元件的感測系統,並將其分發給我們的技術團隊,以便在德克薩斯州、馬里蘭州、丹麥和北卡羅來納州的不同條件下進行初步測試。破壞性地收集雜草生物量以將影像與雜草效能聯絡起來。

資料收集方法

為了創造最佳的雜草生長動態範圍,我們在德克薩斯州、馬里蘭州和北卡羅來納州三個地點建立了田間試驗(圖3)。我們包含了許多具有不同生長特徵的植物物種,包括雜草和覆蓋作物(CC),以在實際操作條件下測試OAK-D。

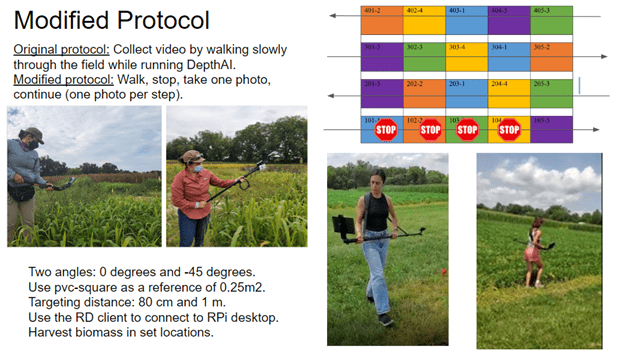

最初的計劃是執行DepthAI(圖4),在我們緩慢穿過田間時收集影片。

不幸的是,推理RGB攝像頭和立體攝像頭之間存在同步問題:RGB攝像頭比單目攝像頭提前幾秒開始,這使得無法關聯資料包序列號。

修訂後的方法要求我們更改田間資料收集協議。我們不再持續使用影片進行監測,而是需要停止、拍攝靜止影像,然後繼續沿樣帶前進。我們覆蓋了所有樣帶,沿途每一步拍攝一張靜止照片。

結果資料

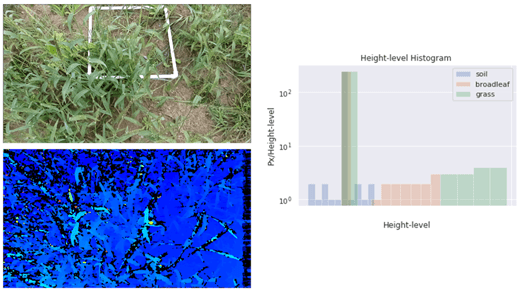

我們使用修改後的Luxonis指令碼以16位NumPy陣列格式獲取原始深度資訊,而不是簡單的視差圖(圖5)。

由於影像採集問題(自動曝光、自動白平衡和自動對焦),我們必須執行原始資料庫清理才能執行生物量測量檢測模型。

語義分割

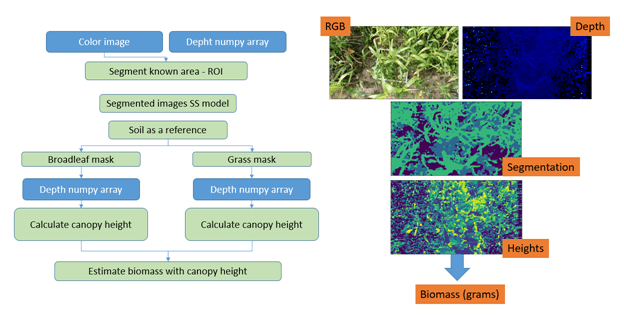

為了預測雜草組成,使用OAK-D攝像頭收集的冠層影像被分割成相關的類別:1)土壤、2)草和3)闊葉植物。此資訊與深度測量值融合,不僅可以預測相對組成,還可以預測絕對值。

一個帶有MobileNet-v3骨幹網路的DeepLab-v3+模型被實現為輕量級的語義分割模型,適用於嵌入式環境。與常用的Xception-65骨幹網路相比,此實現減少了記憶體和計算能力方面的佔用空間,但代價是準確性降低。

合成數據建立

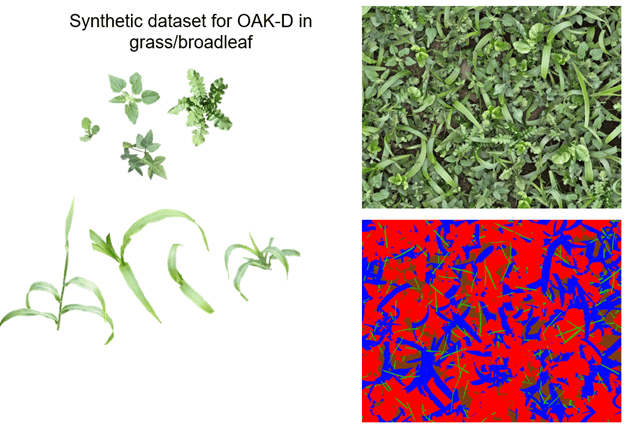

我們在監督設定中訓練模型,需要一個包含所有畫素的精確註釋影像資料集。不考慮當前的一步學習研究,通常需要數百或數千個帶標籤的影像才能實現模型的充分泛化。

依靠每個物種內植物之間的高度相似性,建立了一個合成數據集以最大程度地減少標註工作。按照Skovsen等人(2017)和Skovsen等人(2019)的原則,如圖6所示,從真實影像中數字剪切出48個植物樣本,如下一張圖所示,並將其分類為草或闊葉植物。

模型測試

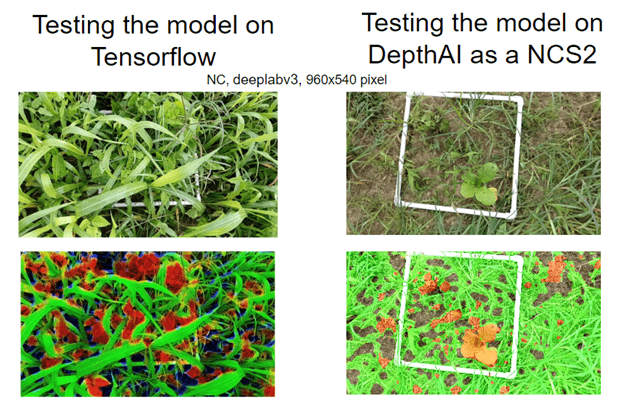

由於記憶體限制降低了我們的分割模型精度,因此我們選擇繼續開發:1)在英特爾神經計算棒上使用DepthAI,以及2)透過TensorFlow-lite庫直接在主機上處理資訊。

獲取影像後,它將由語義分割模型處理,該模型檢測草、闊葉和土壤。然後,語義分割中生成的掩碼將與攝像頭也收集的深度圖(估計檢測到的植物高度)一起使用,以估計生物量。圖8。

開發過程

我們首先找到深度測量中的均方根誤差,然後嘗試在NCS2模式下執行模型。DepthAI能夠執行模型,但在我們當時的測試中,僅在較小的模型上執行良好,在較大的模型上返回段錯誤。

我們修改了資料收集指令碼,將原始深度資料收集到NumPy陣列中,以使體積分析不那麼密集。然後,這些影像用於根據使用已知面積的白色PVC管作為參考提取的感興趣區域計算體積。透過進行3D重建和恢復資料的點雲,對相同的影像進行靜態影像分析。

進一步的實驗將包括改進基於ROI的方法以及使用點雲進行體積估計。即時處理效果不佳,因為當我們使用較小的模型大小時,分割質量會下降。因此,我們決定目前使用非即時方法。您可以在我們的Github程式碼庫中找到程式碼。

結果

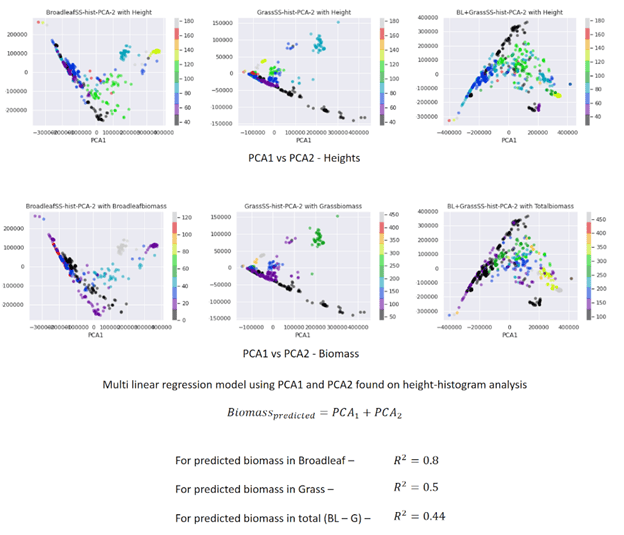

透過我們的策略,我們能夠使用攝像頭收集植物高度。使用從主機生成的柱狀圖,我們使用主成分分析降低了維度,取前兩個成分,並使用它們構建了一個多元線性迴歸模型來找到估計的生物量。

0.5到0.8之間的決定係數表明OAK-D攝像頭有可能測量我們田間存在的雜草的生物量。

未來,我們打算利用DepthAI平臺的新功能提高深度測量的準確性,並解決影片資料採集問題,以實現即時分析。

團隊與致謝

我們是精準可持續農業團隊的一員,並以“雜草監測”的提案參加了OpenCV空間人工智慧競賽。在此次競賽中,我們與奧胡斯大學、北卡羅來納州立大學、美國農業部農業研究局和德克薩斯農工大學合作。

感謝Luxonis對我們所有錯誤和問題提供的持續且及時的幫助。

感謝Julian Cardona設計的3D相機外殼。

本研究基於美國農業部國家食品與農業研究所根據授予編號2019-68012-29818提供的支援工作,透過覆蓋作物和創新的資訊科技網路增強美國作物系統的可持續性。